No More Anonymous Ghosts: NIST’s Framework for AI Credentials and Accountability

- Bob Rapp

- Mar 15

- 7 min read

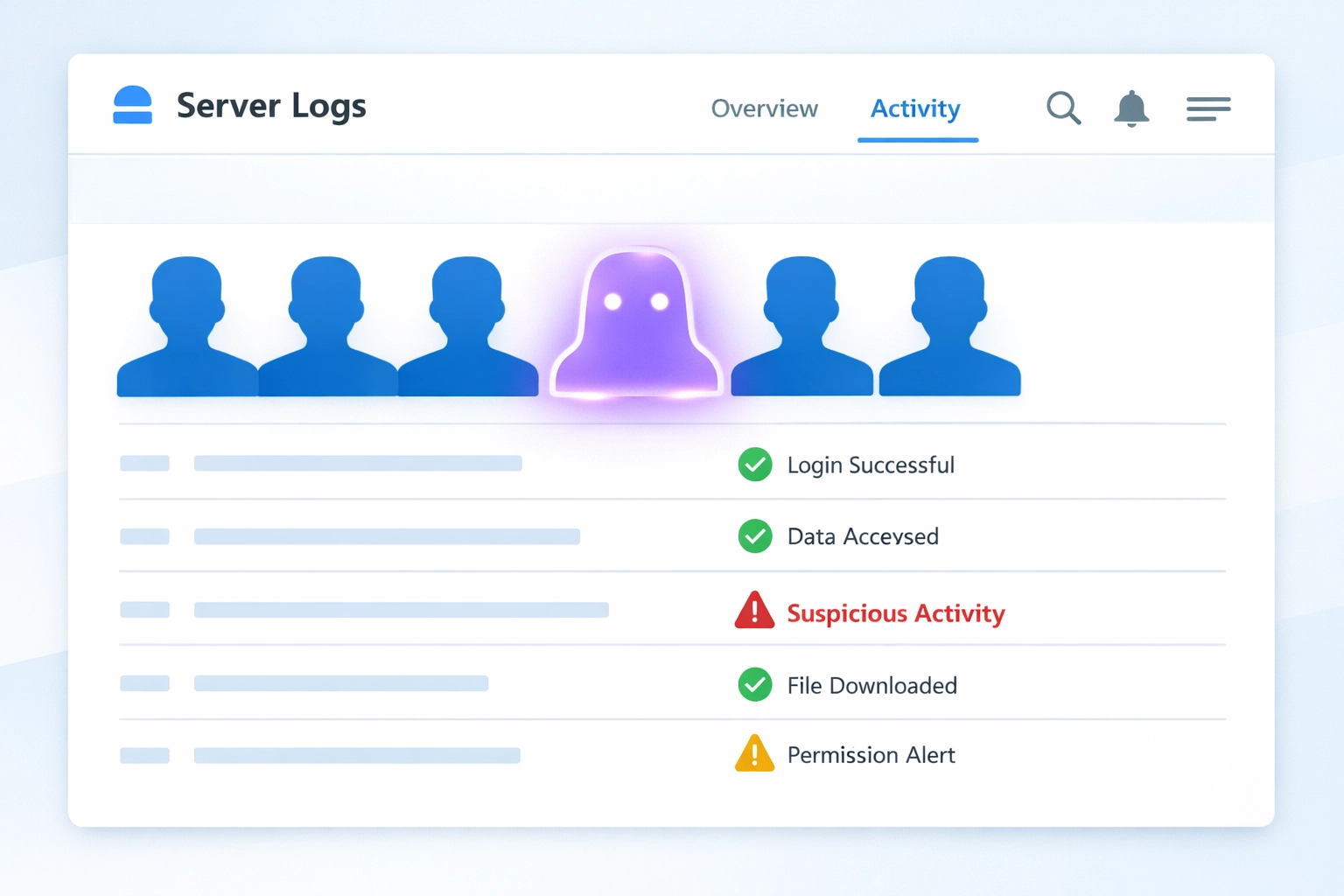

Shape Your Secure Future: Identifying the Ghosts in Your Logs

Let’s be real for a second: if you looked at your server logs right now, do you actually know who—or what—is making those API calls? For most of us, the answer is a bit spooky. We’ve entered the era of the "Anonymous Ghost."

These are AI agents and autonomous services that are currently operating under the radar. They don't have their own IDs; instead, they’re piggybacking on human developer keys or generic service accounts. When something goes sideways—an accidental data leak or a weird prompt injection—the logs just show "Bob Rapp" or "Admin." But it wasn't Bob. It was an AI agent Bob kicked off three hours ago.

The National Institute of Standards and Technology (NIST) has officially called time-out on this practice. With their latest Cybersecurity Framework Profile for Artificial Intelligence, NIST is moving AI from a "tool" to a "first-class cyber actor."

At AI Gov Ops, we’ve seen over 500 organizations struggle with this exact visibility gap. It’s time to stop treating AI like a guest and start treating it like an employee with a badge.

Join the Accountability Movement: AI as a First-Class Actor

The shift NIST is proposing isn't just a minor tweak; it’s a fundamental reframing of Identity and Access Management (IAM). In the old world, we had users (humans) and systems (static code). AI sits right in the middle—it’s dynamic, it makes decisions, and it acts at machine speed.

NIST’s framework requires that AI agents operate as traceable, credentialed actors. This means:

Unique Traceable Identities: Every agent gets its own ID. No more sharing.

Issued Credentials: Specific keys for specific agents with defined expiration dates.

Defined Permissions: The principle of least privilege, applied to machine intelligence.

Continuous Monitoring: Real-time logging of what the AI does, not just what the human told it to do.

By implementing these standards, you aren't just checking a compliance box; you're building a foundation of trust. When your AI has a "face" in your system, you can finally see the 10,000+ automated interactions happening every hour with total clarity.

Build a Trusted Infrastructure with Zero Trust for AI

If you’ve been in the security game for a while, you know "Zero Trust" is the gold standard. NIST is now applying those same principles—continuous verification and explicit validation—directly to AI.

Why does this matter? Because AI agents are high-velocity actors. A compromised AI agent can do more damage in ten seconds than a human could do in ten hours. By integrating AI into your Zero Trust architecture, you ensure that every single action is authenticated and authorized in real-time.

The NIST Implementation Roadmap

Inventory Everything: You can’t protect what you can’t see. Start by mapping out every AI model, API, and agent currently running in your environment.

Restrict Arbitrary Code: One of the biggest risks NIST highlights is AI agents executing unvetted code. Your framework needs to lock this down.

Integrate Risk into Your Appetite: AI-specific risks shouldn't be a separate document. They need to be part of your formal organizational risk statement.

Credentialing: Move away from static human-linked keys. Use the AI Gov Ops platform to automate the issuance of unique AI identities.

Be Part of the Solution: Why Unique IDs Matter

Imagine a scenario where an autonomous agent decides to "optimize" a database by deleting what it perceives as redundant records. Without unique credentials, your forensic team will be chasing their tails looking for a human error that doesn't exist.

With the NIST framework, that action is tied directly to Agent_Alpha_v2. You can see exactly which model version was running, what permissions it had, and why it made that choice. This isn't just about security; it’s about accountability.

We are currently helping teams across the globe move toward this "Identity-First" AI model. Whether you are a small startup or a massive enterprise, the "Anonymous Ghost" problem is a ticking time bomb.

Take Charge of Your Governance Strategy

The NIST guidelines are a gift to those of us trying to do AI right. They provide the "Protect" function that has been missing from the rapid-fire deployment of Large Language Models (LLMs).

Ready to stop the guesswork? You can sign up for our platform to start mapping your AI identities today, or book a demo to see how we automate the NIST requirements for your specific tech stack.

Plus de Fantômes Anonymes : Le Cadre du NIST pour les Identifiants et la Responsabilité de l'IA

Façonnez votre avenir sécurisé : Identifiez les fantômes dans vos journaux

Soyons réalistes un instant : si vous regardiez vos journaux de bord (logs) serveur en ce moment même, sauriez-vous réellement qui — ou quoi — effectue ces appels API ? Pour la plupart d'entre nous, la réponse est un peu inquiétante. Nous sommes entrés dans l'ère du « Fantôme Anonyme ».

Il s'agit d'agents d'IA et de services autonomes qui opèrent actuellement sous le radar. Ils n'ont pas leur propre identité ; au lieu de cela, ils utilisent les clés API de développeurs humains ou des comptes de service génériques. Quand quelque chose tourne mal — une fuite de données accidentelle ou une injection de prompt bizarre — les logs indiquent simplement « Bob Rapp » ou « Admin ». Mais ce n'était pas Bob. C'était un agent d'IA que Bob a lancé il y a trois heures.

Le National Institute of Standards and Technology (NIST) a officiellement sifflé la fin de la récréation pour cette pratique. Avec son dernier profil de cadre de cybersécurité pour l'intelligence artificielle, le NIST fait passer l'IA de « simple outil » à « acteur cybernétique de premier plan ».

Chez AI Gov Ops, nous avons vu plus de 500 organisations lutter contre ce manque de visibilité. Il est temps d'arrêter de traiter l'IA comme une invitée et de commencer à la traiter comme une employée avec son propre badge.

Rejoignez le mouvement de la responsabilité : L'IA comme acteur de premier rang

Le changement proposé par le NIST n'est pas qu'un simple ajustement mineur ; c'est un recadrage fondamental de la gestion des identités et des accès (IAM). Dans l'ancien monde, nous avions des utilisateurs (humains) et des systèmes (code statique). L'IA se situe pile au milieu : elle est dynamique, elle prend des décisions et elle agit à la vitesse de la machine.

Le cadre du NIST exige que les agents d'IA fonctionnent comme des acteurs identifiables et accrédités. Cela signifie :

Identités uniques et traçables : Chaque agent reçoit son propre identifiant. Fini le partage.

Identifiants délivrés : Des clés spécifiques pour des agents spécifiques avec des dates d'expiration définies.

Permissions définies : Le principe du moindre privilège, appliqué à l'intelligence artificielle.

Surveillance continue : Un enregistrement en temps réel de ce que fait l'IA, et pas seulement de ce que l'humain lui a dit de faire.

En mettant en œuvre ces normes, vous ne vous contentez pas de cocher une case de conformité ; vous bâtissez un socle de confiance. Lorsque votre IA a un « visage » dans votre système, vous pouvez enfin voir les 10 000+ interactions automatisées qui se produisent chaque heure avec une clarté totale.

Construisez une infrastructure de confiance avec le Zero Trust pour l'IA

Si vous travaillez dans la sécurité depuis un certain temps, vous savez que le « Zero Trust » est la référence absolue. Le NIST applique désormais ces mêmes principes — vérification continue et validation explicite — directement à l'IA.

Pourquoi est-ce important ? Parce que les agents d'IA sont des acteurs à haute vélocité. Un agent d'IA compromis peut causer plus de dégâts en dix secondes qu'un humain en dix heures. En intégrant l'IA dans votre architecture Zero Trust, vous garantissez que chaque action est authentifiée et autorisée en temps réel.

La feuille de route de mise en œuvre du NIST

Inventoriez tout : Vous ne pouvez pas protéger ce que vous ne voyez pas. Commencez par répertorier chaque modèle d'IA, API et agent fonctionnant actuellement dans votre environnement.

Restreignez le code arbitraire : L'un des plus grands risques soulignés par le NIST est l'exécution de code non vérifié par des agents d'IA. Votre cadre doit verrouiller cela.

Intégrez le risque dans votre stratégie globale : Les risques spécifiques à l'IA ne doivent pas faire l'objet d'un document séparé. Ils doivent faire partie de votre déclaration formelle d'appétence au risque organisationnel.

Accréditation : Éloignez-vous des clés statiques liées aux humains. Utilisez la plateforme AI Gov Ops pour automatiser l'émission d'identités IA uniques.

Soyez acteur de la solution : Pourquoi les identifiants uniques comptent

Imaginez un scénario où un agent autonome décide d'« optimiser » une base de données en supprimant ce qu'il perçoit comme des enregistrements redondants. Sans identifiants uniques, votre équipe de criminalistique numérique cherchera désespérément une erreur humaine qui n'existe pas.

Avec le cadre du NIST, cette action est directement liée à Agent_Alpha_v2. Vous pouvez voir exactement quelle version du modèle tournait, quelles permissions elle avait et pourquoi elle a fait ce choix. Il ne s'agit pas seulement de sécurité ; il s'agit de responsabilité.

Nous aidons actuellement des équipes du monde entier à passer à ce modèle d'IA « Identity-First ». Que vous soyez une petite startup ou une entreprise massive, le problème du « Fantôme Anonyme » est une bombe à retardement.

Prenez en charge votre stratégie de gouvernance

Les directives du NIST sont un cadeau pour ceux d'entre nous qui essaient de bien faire les choses avec l'IA. Elles fournissent la fonction de « Protection » qui manquait au déploiement rapide des grands modèles de langage (LLM).

Prêt à arrêter les devinettes ? Vous pouvez vous inscrire sur notre plateforme pour commencer à cartographier vos identités IA dès aujourd'hui, ou réserver une démo pour voir comment nous automatisons les exigences du NIST pour votre infrastructure technique spécifique.

This post was created by Bob Rapp, Founder aigovops foundation 2025 all rights reserved. Join our email list at https://www.aigovopsfoundation.org/ and help build a global community doing good for humans with ai - and making the world a better place to ship production ai solutions

Comments